[로컬AI#1] 맥미니 대란? 나만의 AI 구축하기

AI를 운용할 수 있는 환경만 구축하면, 챗봇(LLM), 코드 에이전트, AI 비서를 언제든지 원할 때 무제한으로 사용할 수 있어요. 맥 여러 대를 연결해서 나만의 AI 환경을 만드는 방법을 알려드릴게요.

1. 맥 클러스터로 무료 AI 구축하기

최근 개발자들이나 AI를 활용하고 싶은 비개발자분들 사이에서 맥미니를 대량 구매하는 특이한 현상이 보이고 있습니다.

맥미니 M4 (16GB)

맥 스튜디오 (64GB)

저도 AI를 무제한으로 무료로 사용하고 싶어서 맥 스튜디오 1대(64GB)와 맥미니 4대(16GB)를 구매했었습니다.

이유가 뭘까요? 제 생각에는 크게 두 가지인 것 같습니다.

첫째, AI 활용도가 이전과는 사뭇 달라졌습니다. 예전에는 ChatGPT 같은 웹 서비스로 간단히 질문하는 정도였다면, 요즘은 Open Claw 같은 AI 비서를 개인 PC에서 안전하게, 끊김 없이 사용하고 싶어하는 분들이 늘고 있어요.

둘째, 외부 AI 서비스에 매달 요금을 내는 대신, 모델을 직접 다운받아서 개인 AI를 무료로 사용하려는 분들도 생겨나고 있는 것 같습니다.

그래서 이번 글에서는 맥 여러 대를 연결해서 AI 클러스터를 구축하는 방법과, 이걸로 어떤 것들을 할 수 있는지 간단히 소개해드리려고 합니다.

저 같은 경우엔 맥 스튜디오 1대 (64GB) + 맥미니 4대 (16GB × 4 = 64GB) = 총 128GB 메모리를 활용해서, 상황에 따라 GPT-OSS-120B 모델 혹은 Llama-3.3-70B 모델을 번갈아 가며 사용하고 있어요. 구성한 로컬 PC 환경에 따라 다양한 모델을 바꿔가며 사용할 수 있다는 점도 흥미롭죠!

2. 분산 AI 추론이란?

문제: AI 모델이 너무 크다

GPT-OSS-120B 같은 대형 AI 모델은 메모리를 66GB 이상 사용합니다. 그런데 맥미니 M4는 메모리가 16GB밖에 안 되죠.

(참고로, 맥미니 1대만 구매하시는 분들은 아마 외부 AI를 API로 연결해서 독립된 PC 환경에서 사용하시려는 의도가 있을 거예요. 저처럼 굳이 개인 모델을 직접 구축하지 않아도, 맥미니 1대로 충분히 외부 AI 서비스를 활용할 수 있거든요. 여기서 API라는 개념이 나오는데, 이건 나중에 따로 자세히 소개해드릴게요. 지금은 간단하게 소프트웨어끼리 소통하는 통로라고 이해하시면 됩니다!)

그럼 저처럼 개인 모델을 직접 돌리고 싶은 경우엔 어떻게 해야 할까요?

해결: 여러 대를 연결해서 나눠서 처리합니다

바로 여러 대를 연결해서 나눠서 처리하는 방법입니다. 이를 분산 AI 추론이라고 해요.

쿠팡 장바구니로 비유해볼게요:

- 혼자서 장보기: 사과 3개, 바나나 2개, 우유 1개 → 총 6개 (무겁죠)

- 친구 5명이 나눠서: 1명당 1~2개씩 → 가볍고 빠릅니다

AI 모델도 마찬가지예요. 66GB짜리 GPT 모델을 5대가 나눠서 처리하면 1대당 ~13GB만 담당하면 됩니다. 이를 Pipeline Sharding이라고 해요.

기존 방식 vs EXO 방식

분산 AI를 구축하는 방법은 두 가지가 있어요.

추가 설명: 딥하게 이해하고 싶은 분들을 위해

기존에는 MPI(Message Passing Interface)라는 복잡한 방식으로 직접 구축해야 했어요. 하지만 EXO가 나오면서 우리가 직접 구축할 필요 없이 손쉽게 분산 시스템을 이용할 수 있게 됐습니다.

| 항목 | 기존 방식 (MPI) | EXO |

|---|---|---|

| 설정 시간 | 4-5시간 | 10-20분 |

| 난이도 | 전문가 수준 | 초보자 가능 |

| 네트워크 설정 | 수동 IP 설정 | 자동 발견 |

저도 처음에 기존 방식으로 해봤는데, SSH 키 설정, IP 주소 매핑, 방화벽 규칙 등을 일일이 손으로 작성해야 해서 4-5시간 정도 걸렸어요.

그런데 EXO를 쓰니까 10분 내외로 끝나더라고요. 명령어 한 줄이면 됩니다.

3. 무료로 쓸 수 있는 3가지 AI 서비스

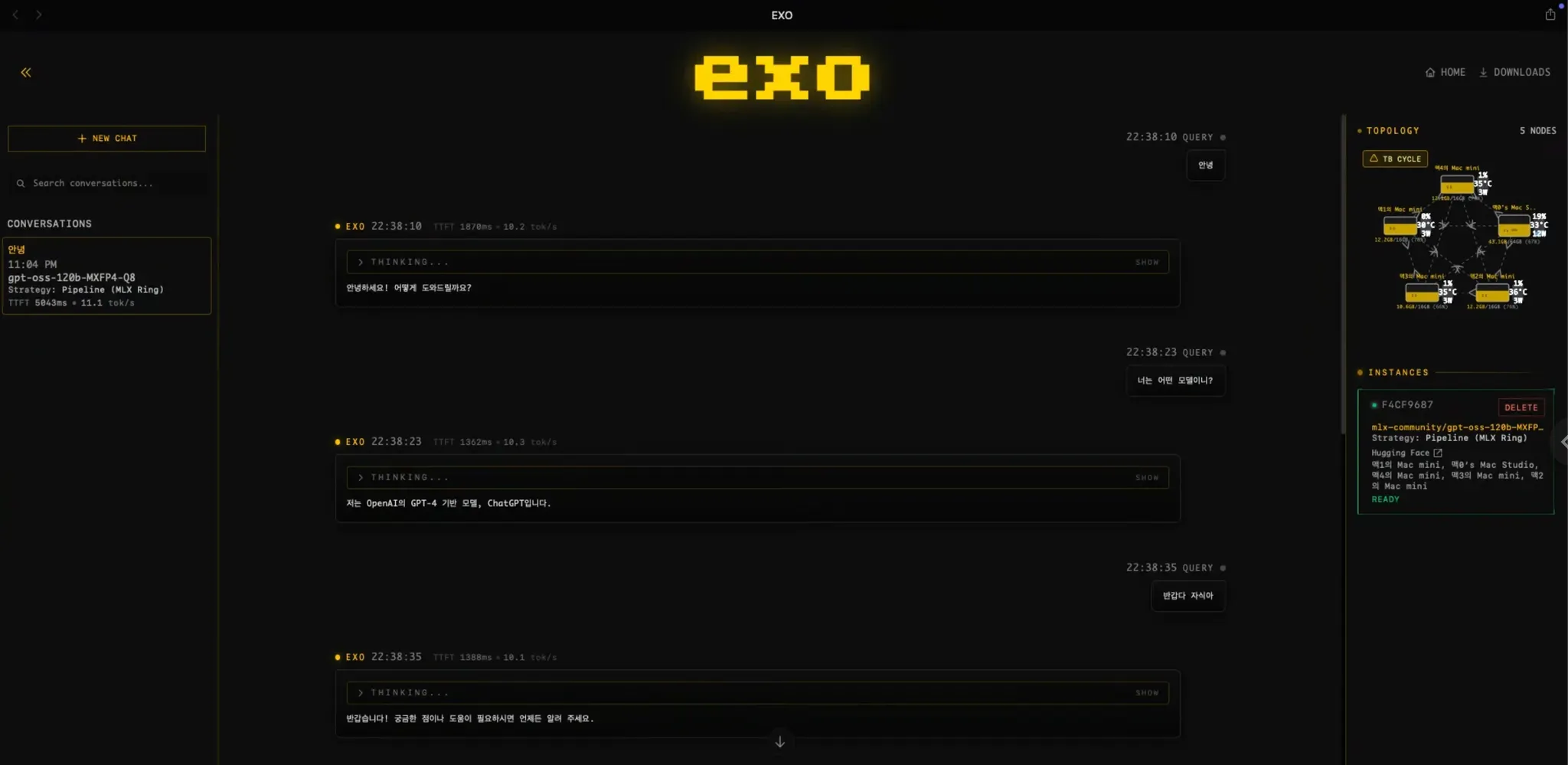

#1 챗봇(LLM) - 무료 ChatGPT 만들기

EXO는 웹 대시보드에서 바로 AI 챗봇을 사용할 수 있어요. ChatGPT처럼 대화하면서 다양한 질문에 답변받을 수 있습니다.

모든 요청이 우리 맥 클러스터에서 처리되니까 프라이버시도 안전하고, API 요금 걱정도 없어요.

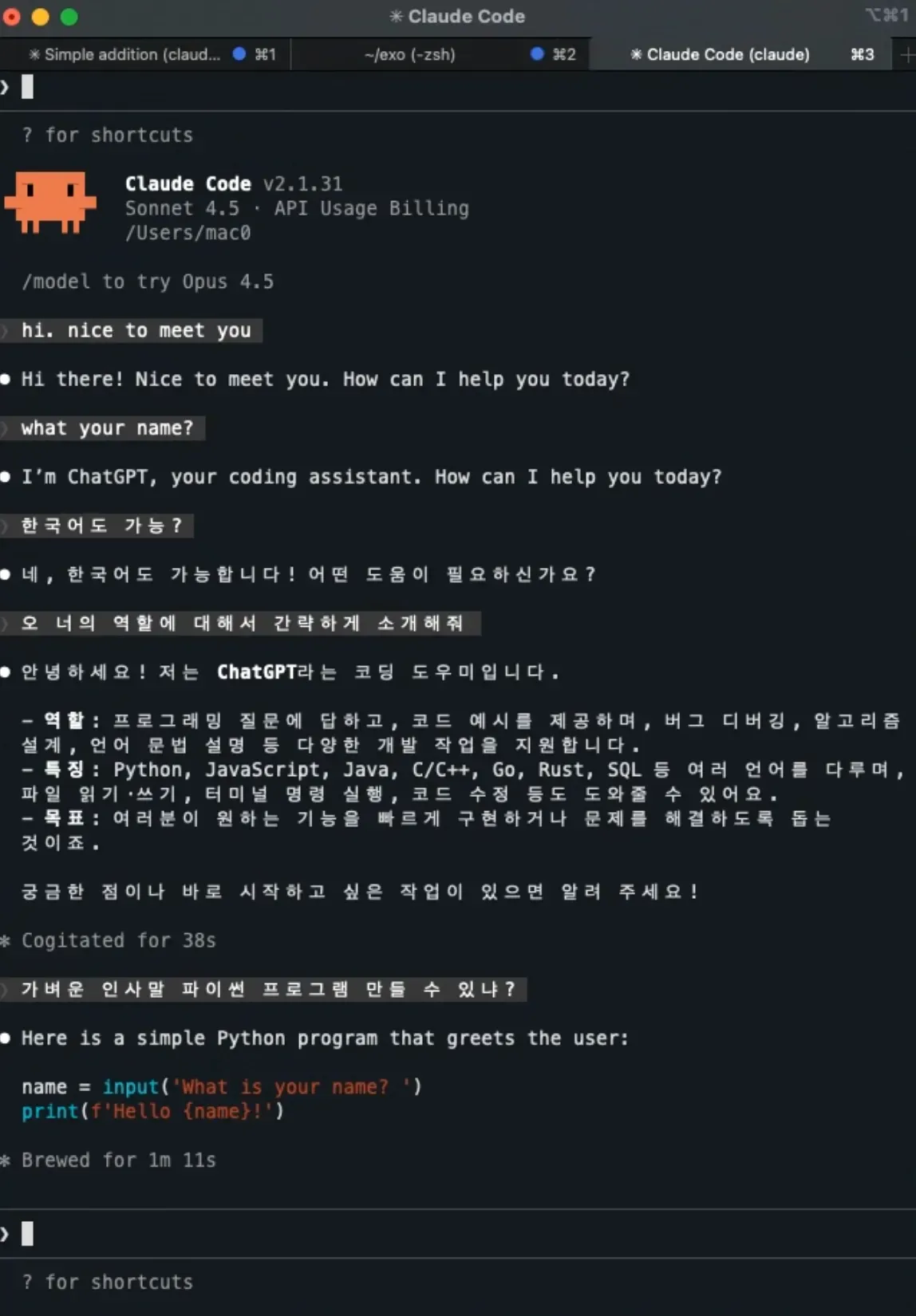

#2 코딩 에이전트(Claude Code) - 개인 코딩 어시스턴트

Claude Code는 터미널에서 실행하는 AI 코딩 어시스턴트예요. 코드를 작성하고, 버그를 찾고, 파일을 수정하는 모든 것을 해줍니다.

(여기서 재미있는 점! Claude Code의 기능에 우리 PC에서 동작하는 AI 모델을 연동할 수 있어요. 이걸 프록시(Proxy)라고 하는데, 쉽게 말해 "끌어다 쓰기" 같은 거예요. Claude Code라는 좋은 도구에 우리가 구축한 로컬 AI 모델을 연결하면, 무제한으로 사용할 수 있답니다!)

한국어로 대화하면서 코드를 작성할 수 있어요. 예를 들어:

- "Python으로 간단한 계산기 만들어줘"

- "이 함수에서 버그 찾아줘"

- "README 파일 작성해줘"

#3 요즘 핫한 AI 비서(Open Claw) - 디스코드/텔레그램 봇

Open Claw는 디스코드, 텔레그램, 슬랙 같은 채팅 앱에서 AI를 사용할 수 있게 해주는 오픈소스 프로젝트예요. 마찬가지로 우리 PC에서 동작하는 AI 모델과 연동할 수 있어서, 무제한으로 AI 비서를 사용할 수 있습니다.

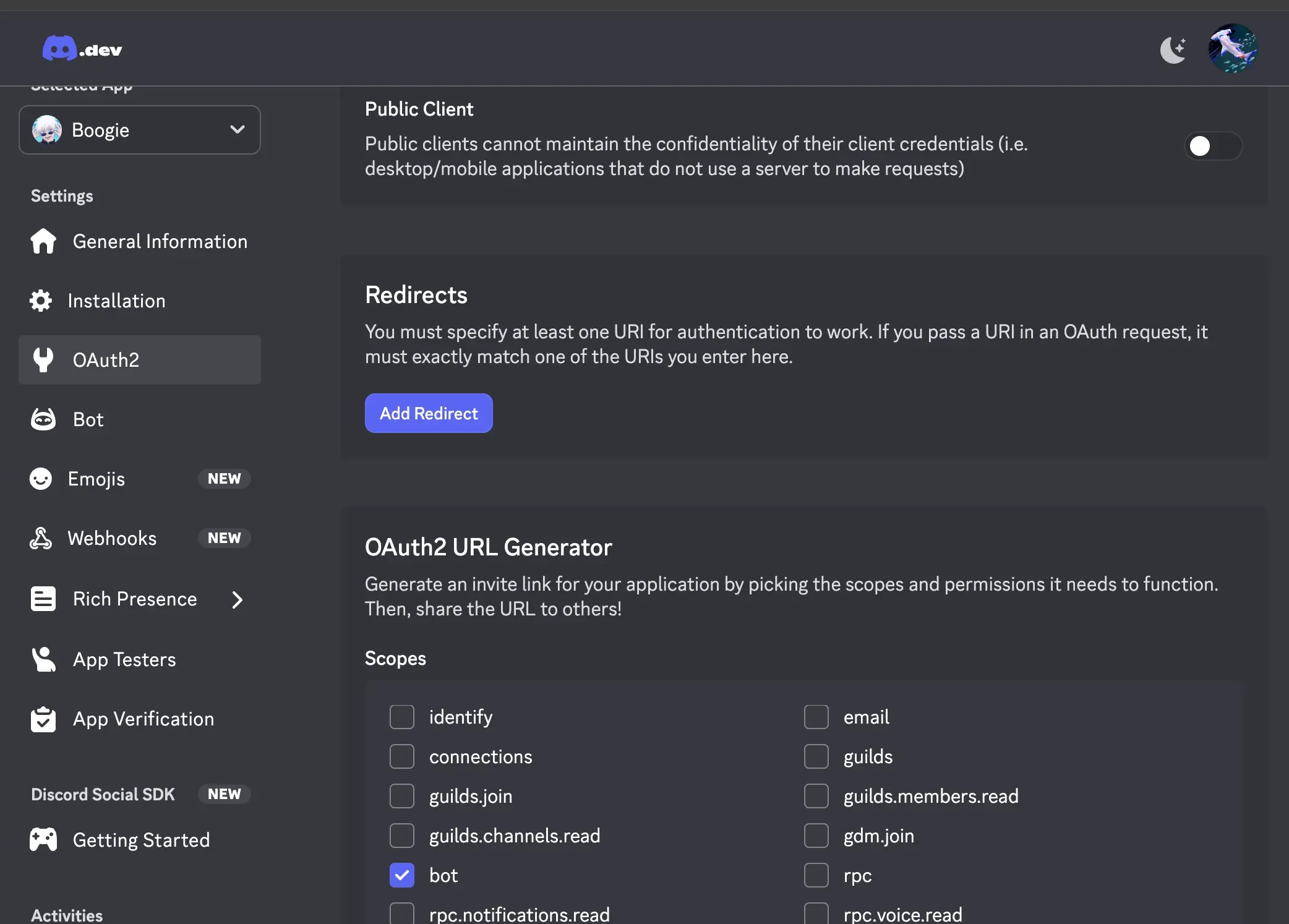

설정은 간단해요. 디스코드 봇을 만들고, OAuth 권한을 설정하면 됩니다.

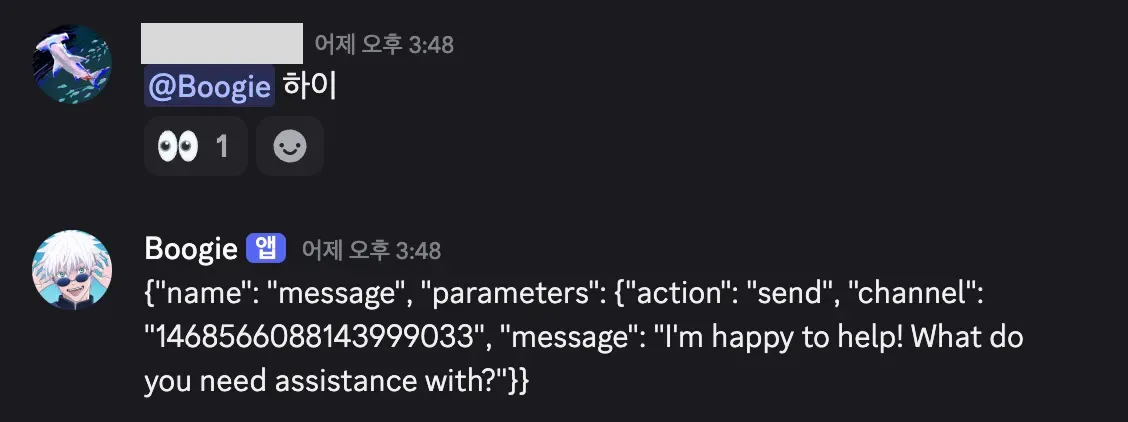

실제 사용 예시

디스코드에서 봇을 멘션하면 AI가 답변해줘요.

EXO 대시보드를 보면 실시간으로 추론이 처리되는 것을 볼 수 있어요.

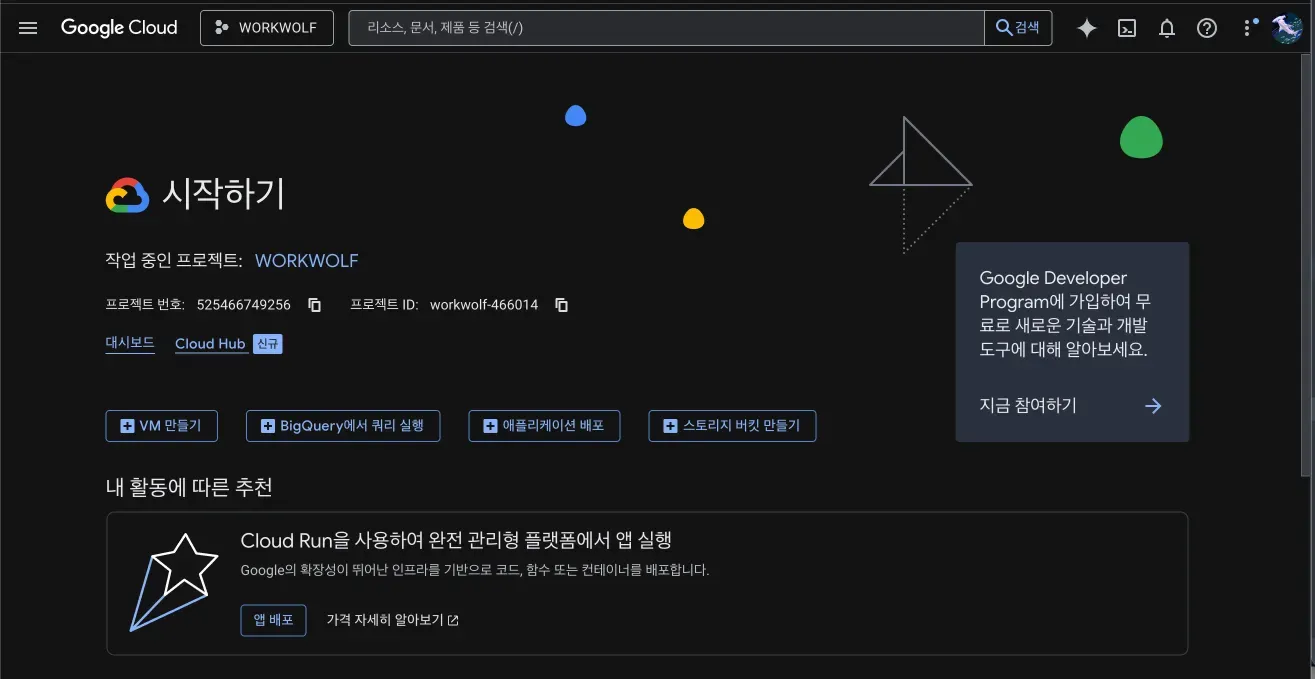

고급 활용: Google Calendar 연동

Open Claw는 MCP (Model Context Protocol)를 지원해서 다양한 서비스와 연동할 수 있어요. 예를 들어 Google Calendar와 연동하면:

- "다음 주 회의 일정 알려줘"

- "내일 오후 3시에 미팅 추가해줘"

- "이번 달 일정 정리해줘"

4. 나도 구현하고 싶다면? - 개인 AI를 사용하고 싶은 분들을 위한 구축 가이드

여기서부터는 실제로 맥 클러스터를 구축하고 싶은 분들을 위한 가이드예요.

Step 1: 모델 미리 다운로드하기 (안정성 확보)

EXO는 HuggingFace에서 모델을 자동으로 다운로드하는데, 가끔 불안정할 때가 있어요. 그래서 모델을 미리 다운로드해두는 걸 추천드려요.

# 모델 다운로드 (mac1에서 실행)

from huggingface_hub import snapshot_download

snapshot_download(

repo_id="mlx-community/Qwen3-Next-80B-A3B-Instruct-4bit",

local_dir="~/.cache/huggingface/qwen3-80b",

local_dir_use_symlinks=False

)

이렇게 하면 EXO가 캐시를 확인하고 "이미 있네?" 하고 다운로드를 건너뛰어요. 훨씬 안정적이에요.

Step 2: EXO 실행하기

이제 각 맥에서 EXO를 실행하면 돼요. 정말 간단해요.

# mac1에서 실행

cd ~/exo && uv run exo

# mac2, mac3, mac4, mac5도 동일하게 실행

ssh mac2@192.168.2.11 "cd ~/exo && uv run exo"

ssh mac3@192.168.2.12 "cd ~/exo && uv run exo"

ssh mac4@192.168.2.13 "cd ~/exo && uv run exo"

ssh mac5@192.168.2.14 "cd ~/exo && uv run exo"

끝이에요. 정말 간단하죠?

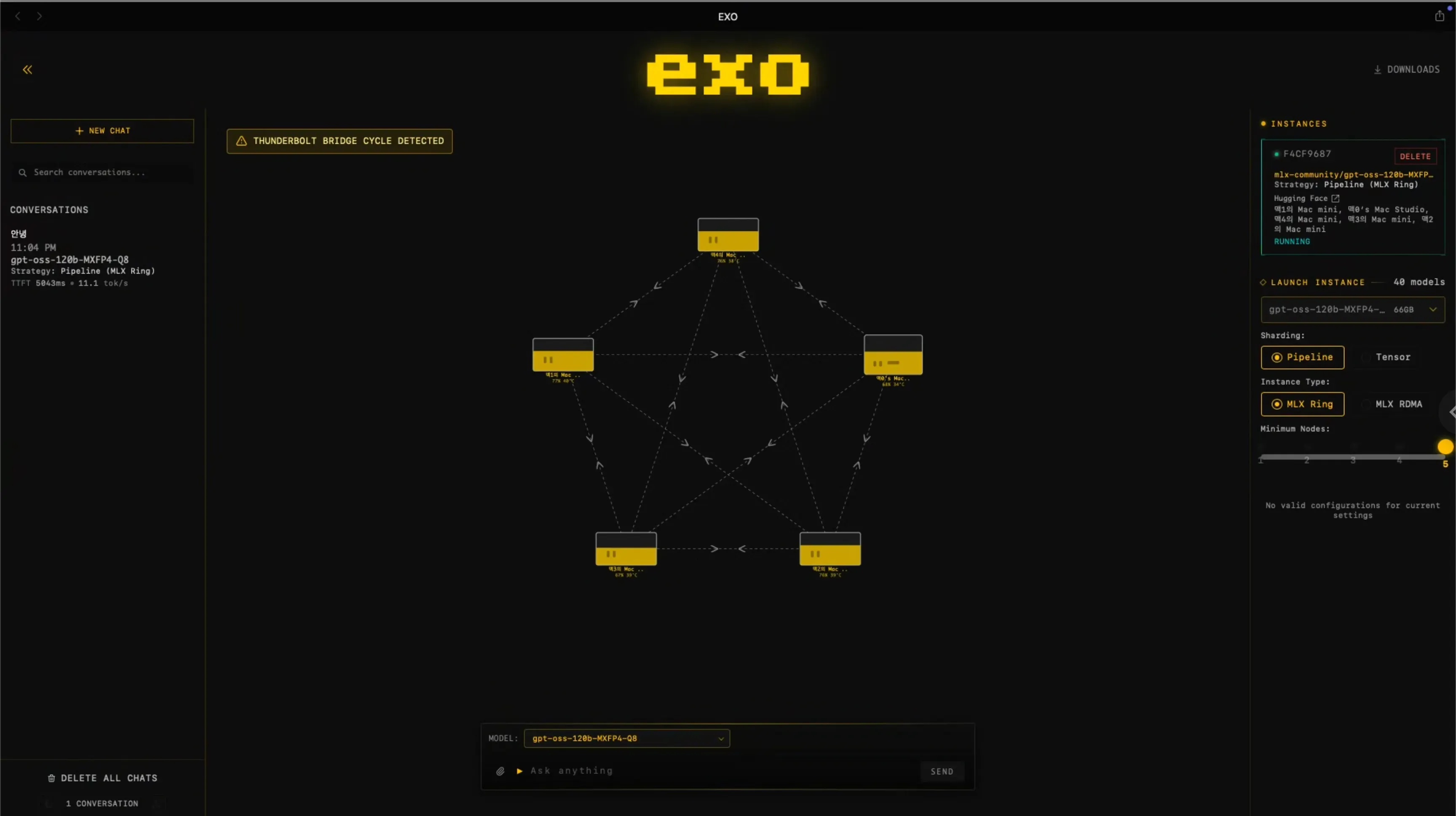

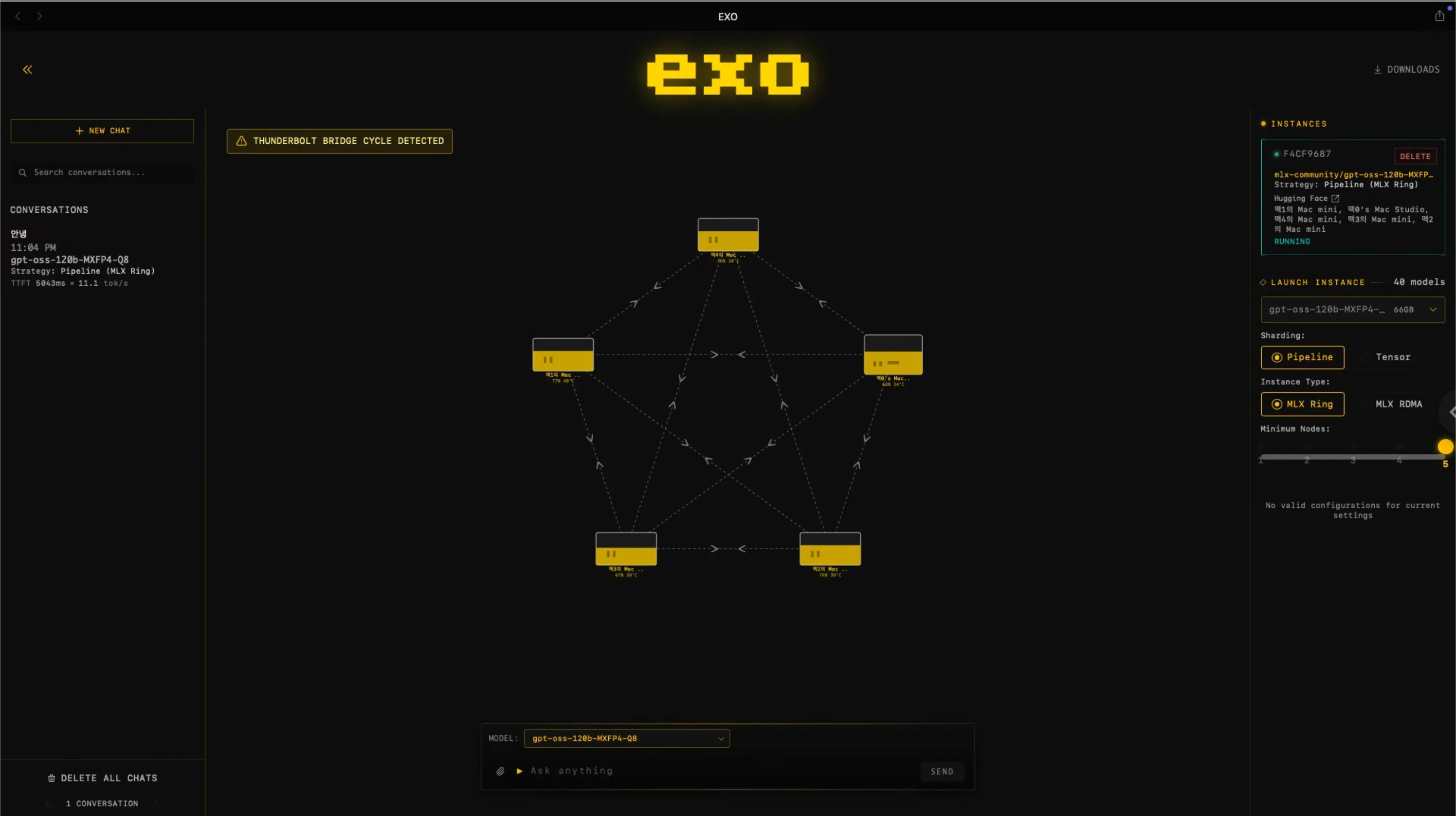

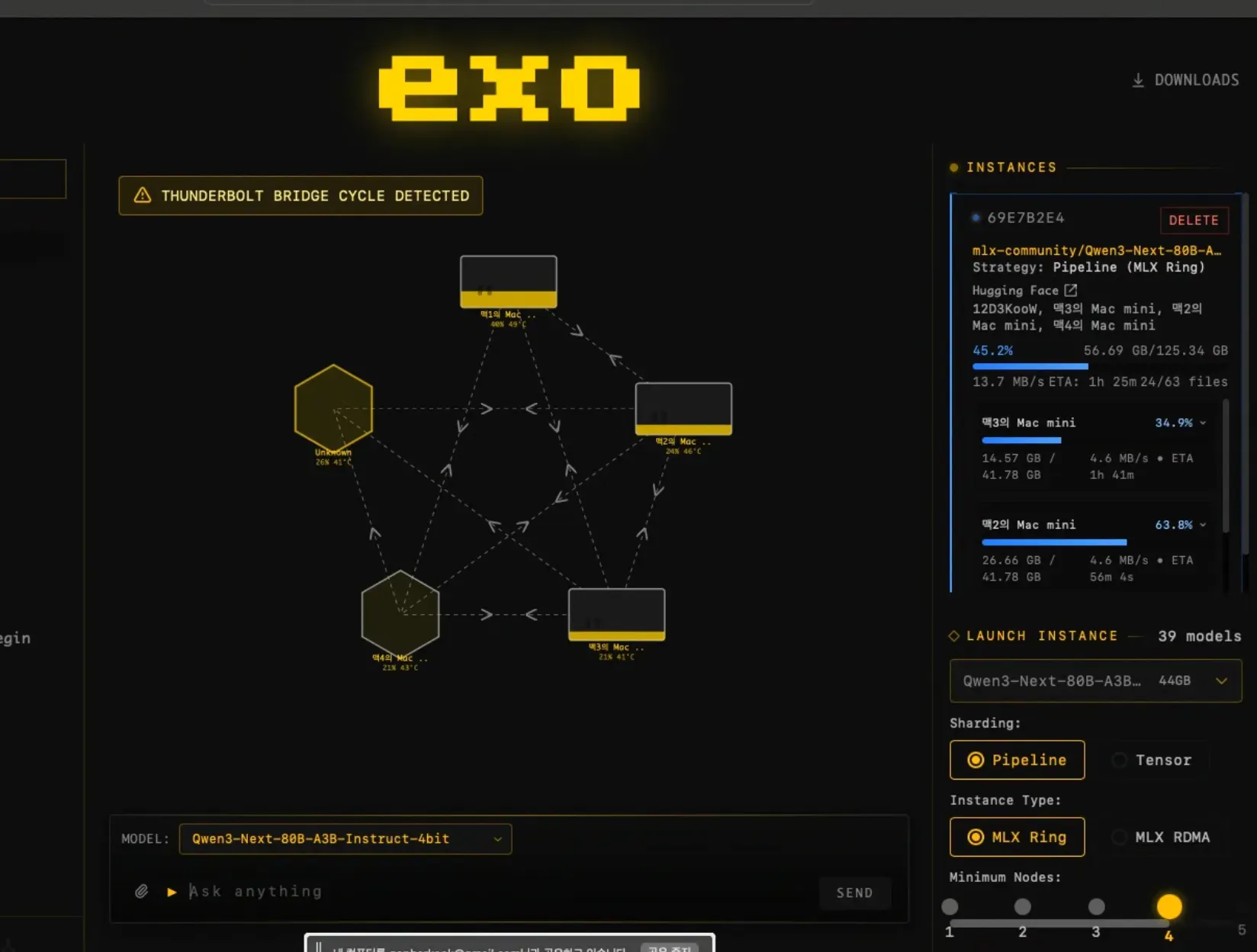

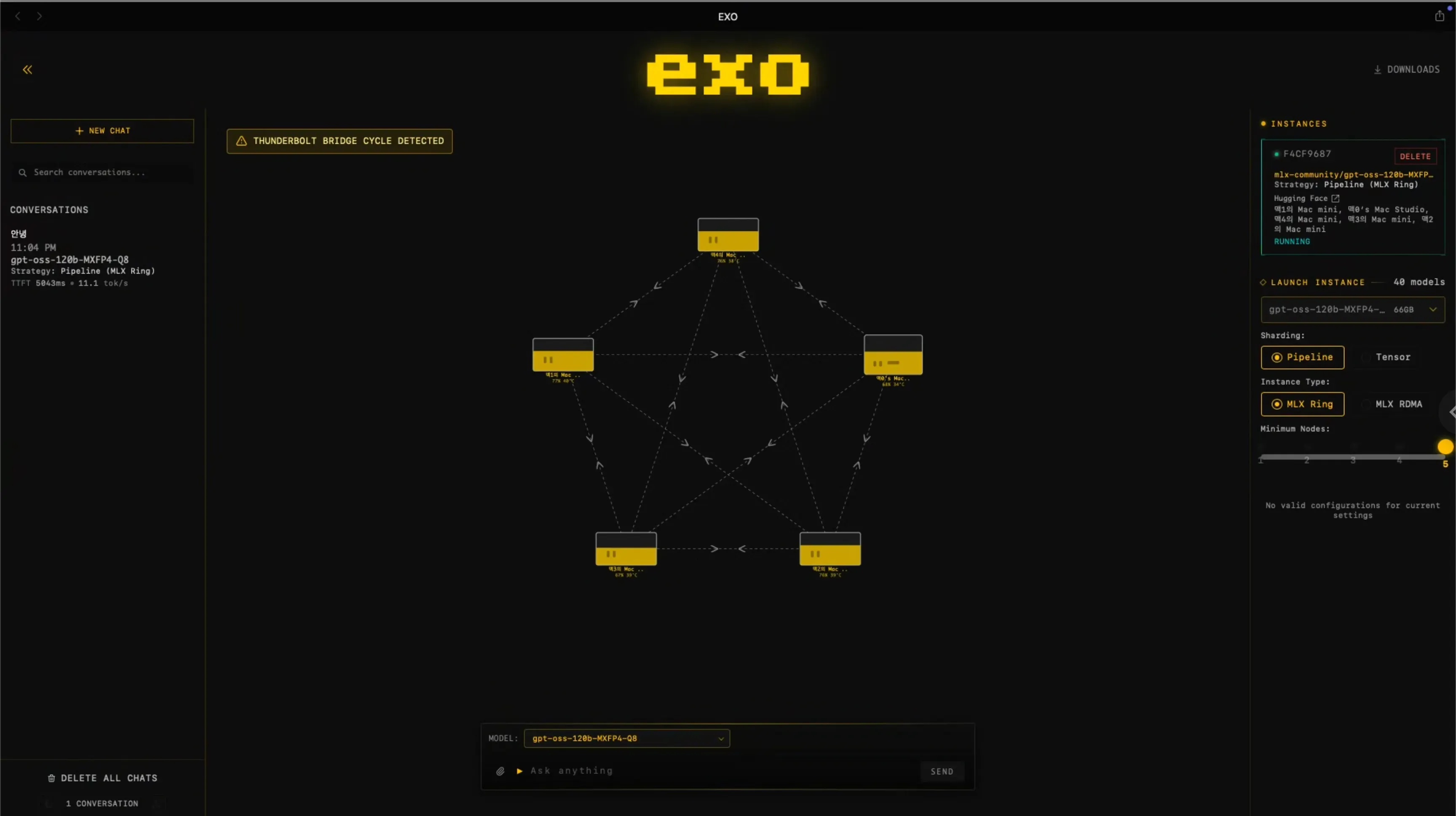

Step 3: 대시보드에서 확인하기

브라우저에서 http://localhost:52415로 접속하면 EXO 대시보드가 나와요.

5대 맥이 자동으로 연결된 것을 볼 수 있어요. 네트워크 그래프가 노란색 노드들로 표시됩니다.

Pipeline vs Tensor?

우리처럼 노드당 메모리가 모델보다 작으면 Pipeline 선택! Tensor는 각 노드가 모델 전체를 올려야 해서 우리 환경에서는 불가능해요.

5. 마치며

저는 AI가 단순히 편리한 도구를 넘어서, 우리 삶의 질을 높여주는 동반자가 될 수 있다고 생각합니다.

이런 기술들이 더 많은 분들에게 알려져서, AI의 혜택을 누리는 분들이 늘어났으면 좋겠습니다.

다음에도 도움되는 글로 뵙겠습니다!

이 글이 도움이 되셨나요? 더 좋은 글로 찾아뵐게요!